本日、私たちは MLSEC.IO を立ち上げます。これは、AI およびセキュリティ コミュニティが現実的な環境で重要な AI システムを攻撃するために力を発揮するための教育的なMachine Learning Security Evasion Competition (MLSEC) です。 Microsoft、NVIDIA、CUJO AI、VM-Ray、MRG Effitas が主催および後援するこのコンテストは、AI ベースのマルウェア検出器と AI ベースのフィッシング検出器を効率的に回避した参加者に報酬を与えます。

機械学習は、金融、ヘルスケア、インフラストラクチャ、サイバーセキュリティなど、ほぼすべての業界で重要なアプリケーションを強化しています。マイクロソフトは、商用 AI システムに対する攻撃が増加していることを認識しており、これらのシステムの機密性、整合性、および可用性の保証を侵害する可能性があります。 MITRE の ATLAS フレームワークによって文書化された公に知られているケースは、AI システムの急増に伴い、これらのシステムを強化する機械学習が敵の目標を達成するために操作されるリスクがどのように高まるかを示しています。展開されたすべての機械学習モデルにはリスクが内在していますが、脅威アクターのツールや動作を検出するために機械学習モデルへの依存度が高まっているサイバーセキュリティでは、脅威は特に明白です。市場調査は一貫して、AI システムのセキュリティとプライバシーが経営幹部にとって最大の懸念事項であることを示しています。 CCS Insight が 2020 年に 700 人の上級 IT リーダーを対象に行った調査によると、セキュリティは現在、企業が AI に関して直面する最大のハードルであり、回答者の 30% 以上が挙げています1 。

しかし、セキュリティ担当者は、この新しいハードルをクリアする方法を知りません。最近のMicrosoft の調査では、28 の組織のうち 25 の組織が、AI システムを保護するための適切なツールを導入していないことがわかりました。学術研究者は 20 年近くにわたって AI システムを攻撃する方法を研究してきましたが、実践者の認識は低いです。そのため、2021 年の Gartner のレポート「 Top 5 Priorities for Managing AI Risk within Gartner’s MOST Framework published 2 」のビジネス リーダー向けの推奨事項の 1 つは、組織が「正式な AI リスク教育キャンペーンを主導することにより、組織全体でスタッフの意識を高める」ことです。

AI システムを保護するための知識を民主化することが重要です。そのため、 Microsoft は最近 Counterfit をリリースしました。これは、AI サービスをプロアクティブに保護することを目的として、Microsoft の AI システムの脆弱性を評価するという私たち自身の必要性から生まれたツールです。敵対的機械学習に慣れていない人のために、NVIDIA は MINTNV をリリースしました。これは、スキルを探索して構築するためのハックザボックス スタイルの環境です。

MLSEC.IO に参加する

本日の MLSEC.IO のリリースにより、意欲的な攻撃者がセキュリティ モデルをどのように回避できるかを強調し、実践者がサイバーセキュリティで使用される重要な機械学習システムを攻撃する筋力を発揮できるようにすることを目指しています。

「セキュリティ コミュニティでは、AI システムの保護または攻撃に関する実践的な知識が不足しています。 Microsoft の MSLEC のようなコンペティションは、機械学習コミュニティだけでなく、攻撃的および防御的なセキュリティ コミュニティのために、敵対的な機械学習の知識を民主化します。 MLSEC の実践的なアプローチは、AML へのエキサイティングな入り口です。」 —クリストファー コットレル、AI レッド チーム リード、NVIDIA

コンテストには、2021 年 8 月 6 日に始まり、2021 年 9 月 17 日に終了する 2 つの課題が含まれます。マルウェア対策回避トラックとフィッシング対策回避トラックです。

- アンチフィッシング回避トラック: 機械学習は、フィッシングを介して初期情報を取得するための非常に成功した攻撃者の手法を検出するために日常的に使用されています。このトラックでは、競技者は攻撃者の役割を果たし、一連のフィッシング対策モデルを回避しようとします。 CUJO AI によってカスタム構築されたフィッシング機械学習モデルは、このコンテスト専用に構築されています。

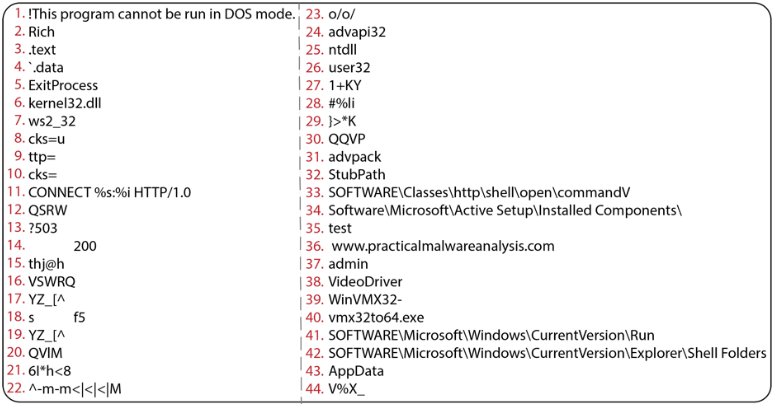

- マルウェア対策回避トラック: この課題は、機械学習ベースのウイルス対策をバイパスしたい攻撃者に別のシナリオを提供します: マルウェア対策モデルからそれを偽装する方法で既存の悪意のあるバイナリを変更します.

さらに、Attacker Challenge トラックごとに、Counterfit (機械学習モデルのセキュリティを調査するための Microsoft のオープンソース ツール) を拡張および活用する最高得点の提出物には、ボーナス賞が授与されます。

「セキュリティ回避の課題は、サイバーセキュリティへの新たな道筋を生み出し、より幅広い人材基盤へのアクセスを可能にします。今年は、参入障壁を下げるために、フィッシング チャレンジを導入すると同時に、マルウェアの経験があまりない人にも参加を強く勧めています。」 —Zoltan Balazs 氏、CUJO AI の脆弱性研究ラボの責任者であり、コンテストの共同創設者。

コンテストに関する主な詳細

- コンテストは 2021 年 8 月 6 日から 9 月 17 日まで開催されます。登録は、コンテスト期間中も引き続き受け付けられます。

- 当選者は 2021 年 10 月 27 日に発表され、メールで連絡されます。

- 2 曲それぞれに 1 位、佳作、ボーナス賞が贈られます。

もっと詳しく知る

2021 年の機械学習セキュリティ回避コンテストの詳細については、次を参照してください。

- 今すぐ登録して、2021 年 8 月 6 日から参加を開始し、攻撃的なセキュリティの筋肉を鍛えましょう。

- Counterfit の詳細については、 Counterfit GitHub リポジトリにアクセスしてください。

- 敵対的機械学習に慣れていない場合は、 NVIDIA の MINTNVハックザボックス スタイルの課題を使用して、AI システムへの攻撃を練習してください。

このコンペティションは、エンジニアが AI システムを安全に開発および展開できるようにするための Microsoft の広範な取り組みの一環です。次のリソースと一緒に使用することをお勧めします。

- セキュリティ アナリストが AI システムに対する脅威に目を向けるために、Microsoft は MITRE と協力して、実稼働機械学習システムに対する攻撃のケース スタディを備えた ATT&CK スタイルのAdvML 脅威マトリックスをリリースしました。

- セキュリティ インシデント対応者向けに、機械学習システムに対する攻撃を体系的にトリアージするために、独自のバグ バーをリリースしました。

- 開発者向けに、機械学習システム専用の脅威モデリング ガイダンスをリリースしました。

- エンジニアと政策立案者のために、Microsoft は、ハーバード大学のバークマン クライン センターと協力して、さまざまな機械学習の失敗モードを文書化した分類法をリリースしました。

今すぐ登録して、2021 年 8 月 6 日に開始し、2021 年 9 月 17 日に終了する機械学習セキュリティ回避コンテストに参加してください。勝者は 2021 年 10 月 27 日に発表されます。

Microsoft セキュリティ ソリューションの詳細については、 当社の Web サイト を参照してください。セキュリティ ブログをブックマークして、セキュリティに関する専門家の記事を入手してください。また、 @MSFTSecurityをフォローして、サイバーセキュリティに関する最新ニュースと更新情報を入手してください。

1 CCS Insight、シニア リーダーシップ IT 投資調査、Nick McQuire et. al、2020 年 8 月 18 日。

2 Gartner、「ガートナーの MOST フレームワーク内で AI リスクを管理するための上位 5 つの優先事項」 、Avivah Litan ほか、2021 年 1 月 15 日。

参考: https ://www.microsoft.com/en-us/security/blog/2021/07/29/attack-ai-systems-in-machine-learning-evasion-competition/

Comments